TVP ЕЖЕНЕДЕЛЬНИК: Чем ИИ отличается от обычной компьютерной программы?

МАРЕК ГАЙДА: Каждая программа состоит из двух компонентов: кода, который описывает, что она должна делать, и базы данных, которую она использует. Самое большое различие заключается в том, что в случае ИИ программа не имеет большого количества информации, указывающей на то, что она должна делать, вместо этого у нее есть гигантская база данных. Это называется "обучающий набор". Мы должны научить ИИ чему-то, чтобы он выполнил определенное действие на основе этого. Обычная компьютерная программа, однако, имеет все в своем коде, разложенном на подносе, с точным указанием, что и как делать.

Я проиллюстрирую это на примере шахматной программы. При классическом подходе мы бы описали в тысячах строк кода все процедуры правильной игры: как двигаются пешки и фигуры, разрешенные и запрещенные ходы и так далее. Кроме того, мы бы проинструктировали программу, что она должна делать в конкретных ситуациях, например: убедиться, что ваша пешка/фигура прикрыта, прежде чем делать ход, а если существует много возможных ходов, мы бы добавили алгоритмы выбора "меньшего из двух зол" или "большего блага". В коде было бы подробно расписано, как выиграть в шахматы.

Создание ИИ для шахмат, с другой стороны, в основном сводится к подготовке коллекции всех сыгранных партий из важных матчей (они доступны в интернете), без указания того, что именно программа должна с ней делать. То есть, что-то вроде: внимательно смотрите эти игры, а потом играйте и выигрывайте сами - вот ваша цель.

Это все еще кажется волшебным. Как и сам искусственный интеллект? И можно ли затем извлечь из него запись о том, что и как он подготовил и выполнил на наборе данных?

Ну, не совсем возможно заглянуть "под капот", особенно в новых решениях глубокого обучения, где программам предоставляются действительно подробные данные, вплоть до мельчайших деталей, и без указания их контекста. Машина полностью самостоятельно решает, как их упорядочить и какой вес им придать. И объем этих данных настолько велик, что человеку невозможно увидеть, что сделал алгоритм.

Подписывайтесь на наш фейсбук

Подписывайтесь на наш фейсбук

Таким образом, ИИ способен анализировать данные и делать из них выводы. Затем создается фиксированный код, который пытается действовать подобно человеческому мозгу - по принципу нейронной сети. Например, в нашем телефоне есть два модных сегодня приложения: одно используется для распознавания марок автомобилей, а другое - для распознавания видов растений. Оба работают так: мы фотографируем объект, а алгоритм угадывает, что это за объект. И оба варианта, основанные на ИИ, совершенно одинаковы: это нейронная сеть, которая должна научиться "распознавать что-то".

Может ли пользователь влиять на них? Например, как ботаник, я могу увидеть ошибку в классификации какого-то растения и исправить ее на благо других пользователей...

Некоторые программы позволяют человеку корректировать решения, выданные машиной. Затем он добавит этот ответ в свой "обучающий набор" как новую информацию. В отличие от этого, в ИИ не так много работы по программированию. Конечно, есть инженеры, которые пишут эти искусственные интеллекты, большие головы, которые создают базовый механизм - "модель системного мозга". И как только он создан, фокус в том, чтобы научить его тому, что мы хотим, и научить его хорошо, т.е. дать хорошие изображения растений, с хорошими описаниями, особыми случаями и т.д. Ведь цветок может выглядеть по-разному в зависимости от времени суток или условий съемки, что и является исходными данными для приложения. Это необходимо знать, поэтому специалисты в этой области также работают над созданием баз.

Несколько недель назад разработчик "сверхинтеллектуального чат-бота LaMDA" Блейк Лемуан признался, что создаваемый им ИИ "обрел сознание". Оставим в стороне вопрос о том, что такое сознание, поскольку здесь у каждой науки свое определение. Давайте сосредоточимся на технических вопросах: как вы думаете, что там произошло?

Искусственный интеллект действует в трех областях. Первый, основной и самый старый, - это так называемая бизнес-аналитика. Она находит применение на крупных предприятиях, где создаются огромные базы данных, будь то бухгалтерия, отдел кадров, маркетинг, продажи и т.д. Менеджеры ожидают, что когда они передадут эти базы данных в искусственный интеллект, система увидит некоторые корреляции, которые невозможно обнаружить невооруженным глазом. Input - вход - это исходные данные, а output - выход - это тоже данные, только уже результат анализа. В бизнес-аналитике для этого чаще всего используются более простые механизмы, называемые машинным обучением, которые анализируют данные механически и вряд ли подойдут к этому творчески.

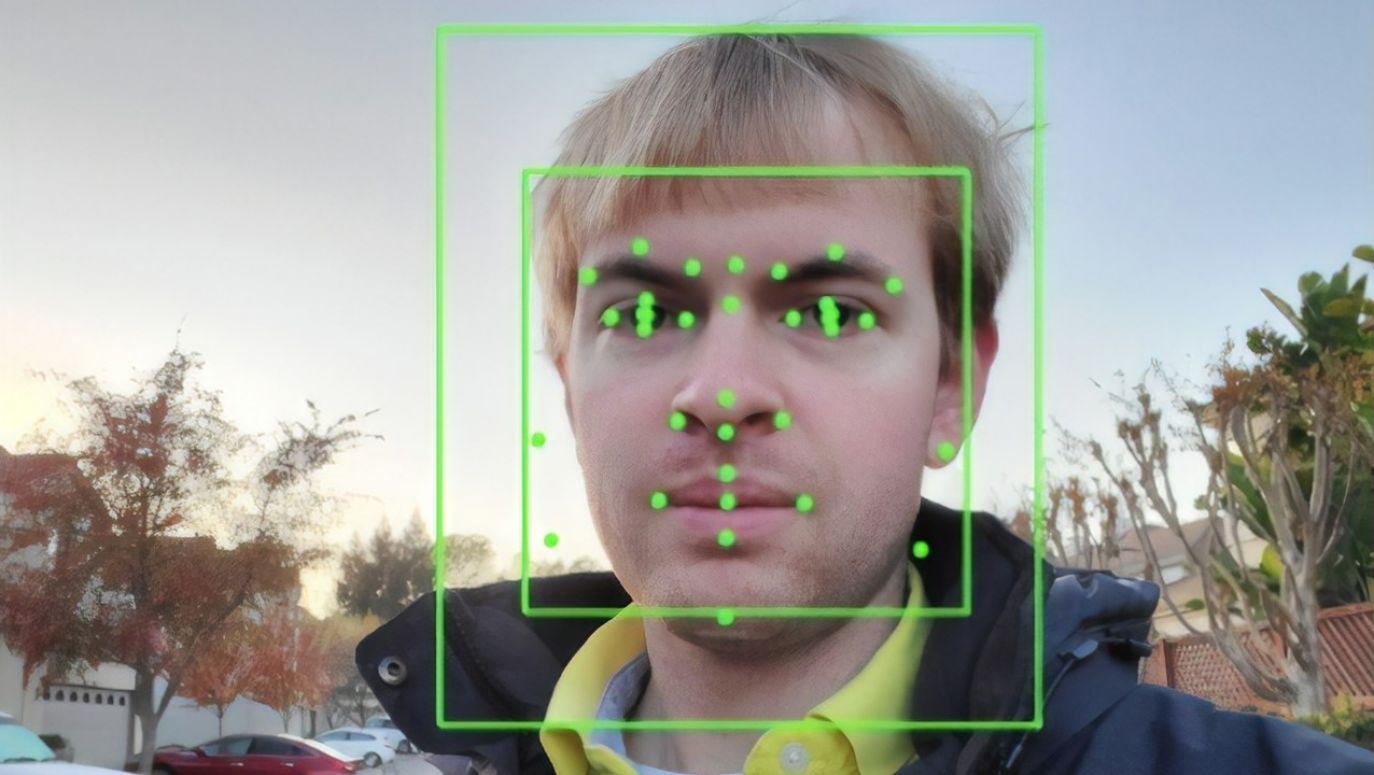

Вторая область ИИ - это вышеупомянутое распознавание вещей. Это касается как гаджетов, так и серьезных гражданских приложений (например, диагностика рака на основе методов визуализации или

идентификация людей по их биометрическим данным) и военных приложений (например, распознавание военных объектов на спутниковых снимках). В этой области ИИ помогает людям делать то, что они могут делать сами, но в отличие от них он не устает, и мы предполагаем, что он не руководствуется предубеждениями.

Подписывайтесь на наш фейсбук

Подписывайтесь на наш фейсбук